A inteligência artificial está evoluindo para um ecossistema colaborativo, onde múltiplos agentes de IA podem interagir, negociar e executar tarefas complexas em conjunto. Essa é a promessa das Plataformas de Consenso Multiagente (MCPs), um conceito que evoca um mercado aberto e dinâmico para serviços de IA. Contudo, essa visão utópica de inovação irrestrita encontra uma barreira intransponível nos setores mais regulados da economia, como o financeiro e o de saúde.

O Nó da Regulação: KYC e a Identidade dos Agentes

O cerne do problema, como destacado em análises do setor, a exemplo da publicada pela VentureBeat, reside na sigla KYC: Know Your Customer (Conheça Seu Cliente). Para um banco, uma seguradora ou um hospital, a identidade e a confiabilidade de qualquer entidade que acesse seus sistemas não são negociáveis. As regulamentações de KYC e de Prevenção à Lavagem de Dinheiro (AML) exigem uma verificação rigorosa de identidade para prevenir fraudes, financiamento ao terrorismo e outras atividades ilícitas. Como, então, aplicar esse princípio a um agente de IA anônimo ou de origem desconhecida operando em uma MCP aberta?

A Inviabilidade do 'Mercado Aberto' em Setores Críticos

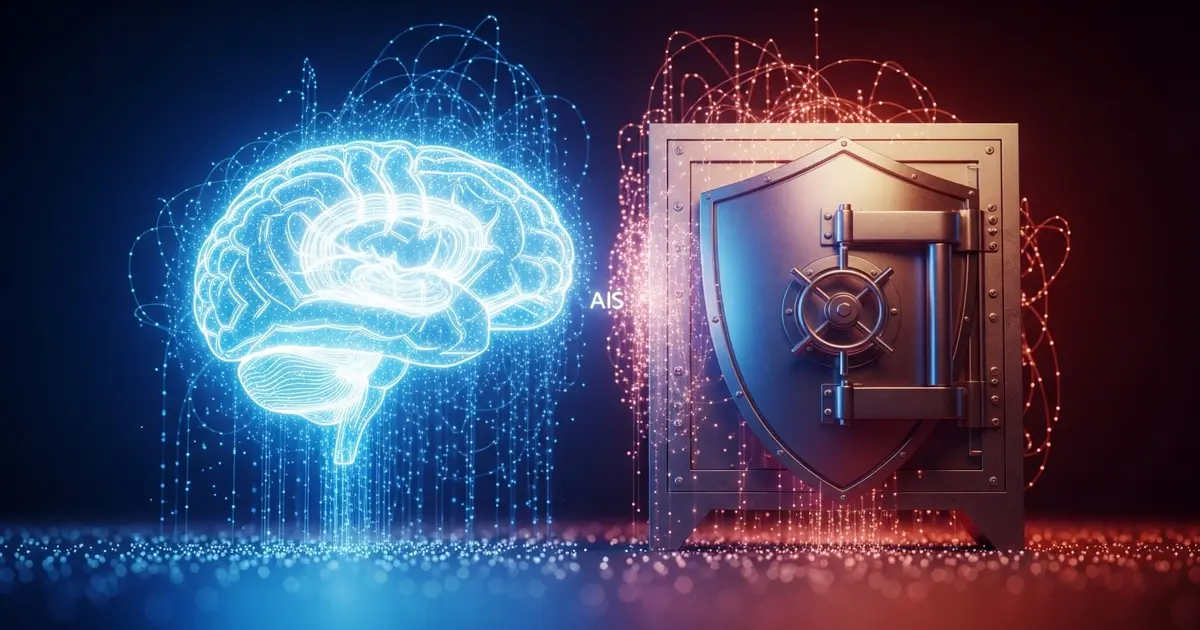

A resposta é simples: não é possível. A natureza 'aberta' que torna as MCPs tão poderosas do ponto de vista tecnológico é exatamente o que as torna inaceitáveis do ponto de vista regulatório. Permitir que um agente de IA não verificado execute uma transferência de fundos ou acesse um prontuário médico seria o equivalente a entregar as chaves do cofre a um estranho. O risco de manipulação, vazamento de dados e fraudes sistêmicas é colossal, e as multas por não conformidade podem chegar a bilhões.

O Futuro é Confiável, Não Totalmente Aberto: Os 'Jardins Murados' da IA

Isso significa o fim da colaboração entre agentes de IA? Longe disso. A análise aponta para uma direção diferente: o surgimento de 'jardins murados' ou ecossistemas de agentes privados e permissionados. Em vez de um mercado aberto e anárquico, as instituições criarão suas próprias bolsas de agentes de IA. Nesse modelo, cada agente seria rigorosamente avaliado, certificado e monitorado. Sua origem, seus desenvolvedores e seus parâmetros operacionais seriam conhecidos e auditáveis. A confiança seria estabelecida antes que qualquer interação com dados sensíveis fosse permitida. Essa abordagem sacrifica a abertura total em prol da segurança e da conformidade. Para os setores regulados, não há escolha. A inovação não pode existir em um vácuo de responsabilidade. Portanto, a verdadeira revolução não será a criação de MCPs totalmente abertas, mas sim o desenvolvimento de plataformas robustas que consigam equilibrar o poder computacional colaborativo com a necessidade imperativa de verificação e confiança. O futuro da IA nesses setores não será 'aberto', mas sim 'confiável', onde cada agente tem um nome, uma identidade e uma reputação a zelar.

(Fonte original: VentureBeat)